Google Revoluciona a Velocidade da IA com Gemma 4 e Decodificação Especulativa

Recentemente, o Google anunciou o lançamento do Gemma 4, um modelo de inteligência artificial (IA) de código aberto com raciocínio avançado, voltado para a criação de bots inteligentes. Essa inovação promete transformar a forma como utilizamos modelos de IA, especialmente no que diz respeito à velocidade de processamento e eficiência em diferentes dispositivos, incluindo smartphones. Neste artigo, vamos explorar como o Google atingiu essa façanha tecnológica e o impacto que ela pode ter na sua experiência com IA no dia a dia.

O que é o Gemma 4 e por que ele é tão importante?

O Gemma 4 representa uma evolução significativa na inteligência artificial desenvolvida pelo Google. Ele é um modelo de IA avançado, capaz de raciocínio complexo e destinado à criação de bots mais inteligentes e responsivos. O que diferencia o Gemma 4 de outros modelos é a sua estrutura aberta, permitindo que desenvolvedores e empresas possam utilizar, modificar e adaptar a tecnologia de forma mais acessível.

Entretanto, toda essa potência de processamento também implica em um maior consumo de recursos computacionais, o que pode gerar respostas mais lentas e exigir hardware mais robusto, principalmente em dispositivos móveis. Para contornar essas limitações, o Google desenvolveu uma técnica inovadora que promete acelerar significativamente o processamento do modelo, mantendo a qualidade das respostas.

Conheça a técnica que aumenta a velocidade do Gemma 4: Multi-Token Prediction (MTP)

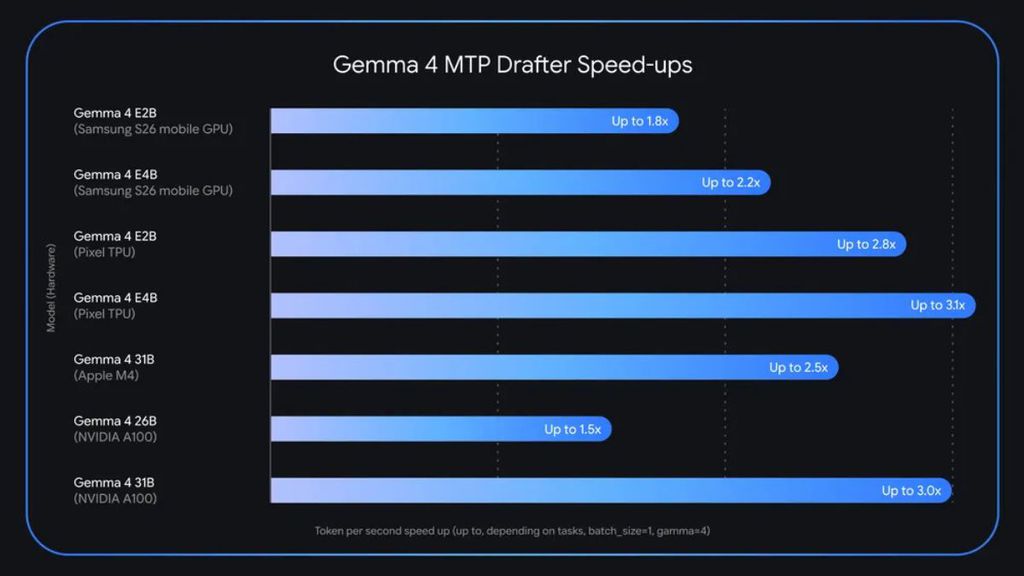

A grande novidade apresentada pelo Google é o uso do Multi-Token Prediction (MTP), uma técnica que permite que o Gemma 4 rode até três vezes mais rápido. Essa abordagem combina o modelo principal com modelos auxiliares menores, que trabalham em conjunto durante o processamento.

Os modelos auxiliares são responsáveis por fazer previsões preliminares, ou rascunhos, de partes da resposta. Essas previsões são então validadas pelo modelo principal em paralelo, enquanto ele continua gerando o restante do texto. Essa estratégia de pré-visualização e validação simultânea é o que acelera o processo de resposta, tornando a IA mais eficiente e útil em aplicações que exigem respostas rápidas, como chats, assistentes de voz e automações.

“Ao usar uma arquitetura de decodificação especulativa, esses modelos de rascunho oferecem até 3x mais velocidade sem qualquer perda na qualidade da saída ou na lógica de raciocínio”, destaca o Google em comunicado.

Como essa combinação acontece na prática?

O segredo para o desempenho superior do Gemma 4 com MTP é uma mudança na forma de gerar o texto. Em vez de produzir uma palavra por vez, o sistema consegue antecipar múltiplos trechos de uma só vez, graças à decodificação especulativa.

Esse método consiste em fazer uma previsão preliminar do que vem a seguir na resposta, enquanto o modelo principal valida essas previsões em tempo real. Assim, o sistema não precisa esperar cada palavra ser gerada passo a passo, o que reduz o tempo de resposta drasticamente.

Imagine que o modelo auxiliar esteja criando um rascunho de uma resposta complexa, como um resumo ou uma explicação detalhada. O modelo principal analisa essas previsões, aceita as mais confiáveis e gera toda a resposta final em uma única passada, com um tempo equivalente a gerar apenas uma palavra ou token normalmente.

“Se o modelo principal concordar com o rascunho, ele aceita toda a sequência em uma única passagem — e ainda gera um token adicional nesse processo. Isso significa que sua aplicação pode produzir toda a sequência prevista mais um token no mesmo tempo que normalmente levaria para gerar apenas um”, explica a empresa.

Quais as vantagens dessa inovação?

- Resposta mais rápida: chatbots, assistentes virtuais e aplicativos de voz terão respostas quase em tempo real, melhorando a experiência do usuário.

- Roda em dispositivos comuns: possibilita executar modelos avançados em PCs comuns ou até offline, facilitando o desenvolvimento e uso diário.

- Economia de energia: melhorias na eficiência também significam menor consumo de bateria em dispositivos móveis.

- Manutenção da qualidade: apesar da velocidade superior, a qualidade e o raciocínio do modelo permanecem altas devido à validação contínua.

Disponibilidade e aplicações práticas do Gemma 4 com MTP

Os modelos auxiliares com MTP do Gemma 4 já estão disponíveis sob a licença Apache 2.0 em plataformas como Hugging Face, Kaggle e Ollama. Eles são compatíveis com várias ferramentas de processamento de linguagem natural, incluindo Transformers, vLLM, llama.cpp, LM Studio e Keras, facilitando sua implementação em diferentes projetos.

A adoção dessa tecnologia promove avanços notáveis em aplicações do cotidiano, como assistentes de voz que respondem mais rápido, chatbots mais eficientes, ferramentas de automação que executam tarefas em tempo real, além de tornar possível rodar modelos avançados em dispositivos com recursos limitados.

Por que entender a diferença entre IA generativa e agentes de IA é importante?

Para quem deseja se aprofundar no universo da inteligência artificial, entender conceitos como diferença entre IA generativa e agentes de IA é fundamental. Essas distinções ajudam a compreender melhor as aplicações práticas, limitações e potencialidades das tecnologias emergentes.

Conclusão

O lançamento do Gemma 4 pelo Google com a técnica de Multi-Token Prediction representa um avanço significativo na velocidade e eficiência da inteligência artificial. Essa inovação permite que modelos de IA mais avançados operem de forma mais ágil, especialmente em dispositivos móveis e ambientes com recursos limitados, sem perder a qualidade do raciocínio. Com essa capacidade de acelerar a geração de respostas em até três vezes, o futuro da IA próxima de nós parece mais acessível, inteligente e eficiente.

Se você quer ficar por dentro das novidades em tecnologia, lançamentos e dicas exclusivas, me siga no Instagram e inscreva-se no meu canal do Youtube para tutoriais completos sobre as melhores IAs.

Tags:

- Inteligência Artificial

- Gemma 4

- IA acelerada

- Multi-Token Prediction

- Modelos de linguagem

- IA em dispositivos móveis

- Automação com IA

- Tecnologia Google

- Decodificação especulativa

- IA open source

Inteligência Artificial,Gemma 4,IA acelerada,Multi-Token Prediction,Modelos de linguagem,IA em dispositivos móveis,Automação com IA,Tecnologia Google,Decodificação especulativa,IA open source